【sevensixTV】に第148弾の動画を配信しました。

00:31 宇宙データセンター構想(Google・NVIDIA)

02:10 国産AI戦略:ソフトバンク主導のAI会社構想

02:44 次世代メモリー「SAIMEMORY」

03:05 GPU搭載AI基地局「AITRAS」

03:21 発電一体型AIデータセンター

03:52 光電融合(CPO)と国家レベルの技術開発

05:14 水冷GPUコンテナ型データセンターPoC

06:11 データセンターと再生可能エネルギー

07:11 ワット・ビット連携とワークロードシフト

07:58 NVIDIA次世代GPU「Rubin」

08:58 アジア最大級の海底ケーブル計画

10:00 AIデータセンター投資の回収問題

11:01 軽量AIモデルと分散型インフラ

12:07 主要記事まとめ

今回は 2025年12月15日〜2026年1月14日 に公開されたニュースの中から、 注目すべき データセンター関連トピックス10選 を解説します。 今回のテーマは主に次の4つです。

・宇宙データセンターとAIインフラ競争

・AI・半導体、通信・電力を一体化した国家戦略

・光電融合など次世代データセンター技術

・AIデータセンターの投資、分散化、将来アーキテクチャ

本動画では、

- GoogleやNVIDIAが関わる宇宙データセンター構想

- ソフトバンク中心の国産AIインフラ戦略

- 次世代インターコネクトとして注目される光電融合技術

など、AI時代のデータセンターを巡る構造変化を分かりやすく整理しています。 AI、半導体、通信、エネルギー、インフラ分野に関心のある方は、ぜひ最後までご覧ください。

=========================================

動画への感想・お問い合わせはコメントまたは公式サイトまで!

https://www.sevensix.co.jp/contact/

=========================================

00:31 宇宙データセンター構想(Google・NVIDIA)

まずは宇宙データセンターの2つの記事をまとめてご紹介します。この2つの記事は、「データセンターを宇宙に作る」という構想が、米国のテック企業を中心に一気に現実味を帯びてきていて、さらに米中の競争領域にもなっている、という内容です。

宇宙データセンターは地球の軌道上にある人工衛星にサーバーを載せて、宇宙空間でデータ処理や保管をする仕組みです。衛星を多数連携させて“衛星群=データセンター”みたいに使う構想です。

注目される理由は、地上のAIデータセンターが抱える制約が大きくなっているからです。電力が足りない、水も必要、立地確保が難しい、さらに反対運動も起きやすい。記事では、2035年に米国のデータセンター電力需要が「原発100基超相当の106GW(ギガワット)」に達する予測が出ている、という話も出ています。

しかし宇宙ですと、太陽光発電を昼夜ほぼ連続で使える可能性があり、冷却も水を使わず廃熱を宇宙へ放出できる、という点が魅力になっています。Googleは「プロジェクト・サンキャッチャー」として、TPU搭載の試験衛星2基を2027年初頭までに打ち上げる計画です。NVIDIAはH100搭載衛星を打ち上げたスタートアップ「スタークラウド」を支援していて、実際にAIモデルを動かしているとも報じられています。

もう一つ重要なのが、安全保障も含めた米中競争です。中国はすでにAI計算用の衛星12基を打ち上げ、将来は数千基規模まで拡大する構想もあります。宇宙データセンターは、電力と通信を一体で最適化する“ワット・ビット連携”を宇宙に広げる取り組みとも言えます。

ただし課題も多くて、打ち上げコスト、放射線による故障、宇宙ゴミ、そして敵対国の攻撃リスクがあります。そのため当面は、地上データセンターと宇宙データセンターで相互バックアップする形が前提になりそうです。

02:10 国産AI戦略:ソフトバンク主導のAI会社構想

続いてはロボ、AI、ソフトバンクという切り口で4つの記事を見ていきますが、そこから見てきたのは、日本主導で「AI・半導体・通信・電力」を一体で押さえにいく大きな国家戦略の動き、という内容です。

まず一つ目は、経産省が5年間で1兆円規模を支援し、ソフトバンク中心に国産AIの新会社を設立する構想です。ロボットや自動運転を制御する「フィジカルAI」向けに、1兆パラメーター級の国産基盤モデルを開発します。その計算基盤となるデータセンターは、苫小牧や堺で整備中の施設が候補です。AI基盤を国内に持つというのが最大の狙いです。

02:44 次世代メモリー「SAIMEMORY」

二つ目は、そのAIを支えるハードの話です。ソフトバンク主導の「SAIMEMORY」(サイメモリー)に富士通が参画し、HBMの代替となる次世代メモリーを開発します。容量は2〜3倍、消費電力は半分を目標。量産は29年度を目指します。AIデータセンターのボトルネックであるメモリーを国産で押さえようという動きです。

03:05 GPU搭載AI基地局「AITRAS」

三つ目は通信インフラ。ソフトバンクはGPU搭載のAI基地局「AITRAS」(アイトラス)を26年から導入します。基地局自体がエッジAIとして動き、クラウドや大規模データセンターへの依存を減らします。自動運転やロボットなど、低遅延が不可欠なフィジカルAIを支える分散型インフラです。

03:21 発電一体型AIデータセンター

そして四つ目が電力。OpenAIがソフトバンクグループ傘下の発電会社SBエナジーに約790億円出資し、1.2GW規模のAIデータセンターをテキサスで整備します。発電とデータセンターを一体で開発するモデルです。

つまり今、日本勢は「AIモデル」「半導体メモリー」「エッジ通信」「発電一体型データセンター」という4層でAIインフラを構築しようとしています。AI時代はデータセンター単体ではなく、電力・半導体・通信を含めた総合インフラ競争に入っている、というのが大きなポイントです。

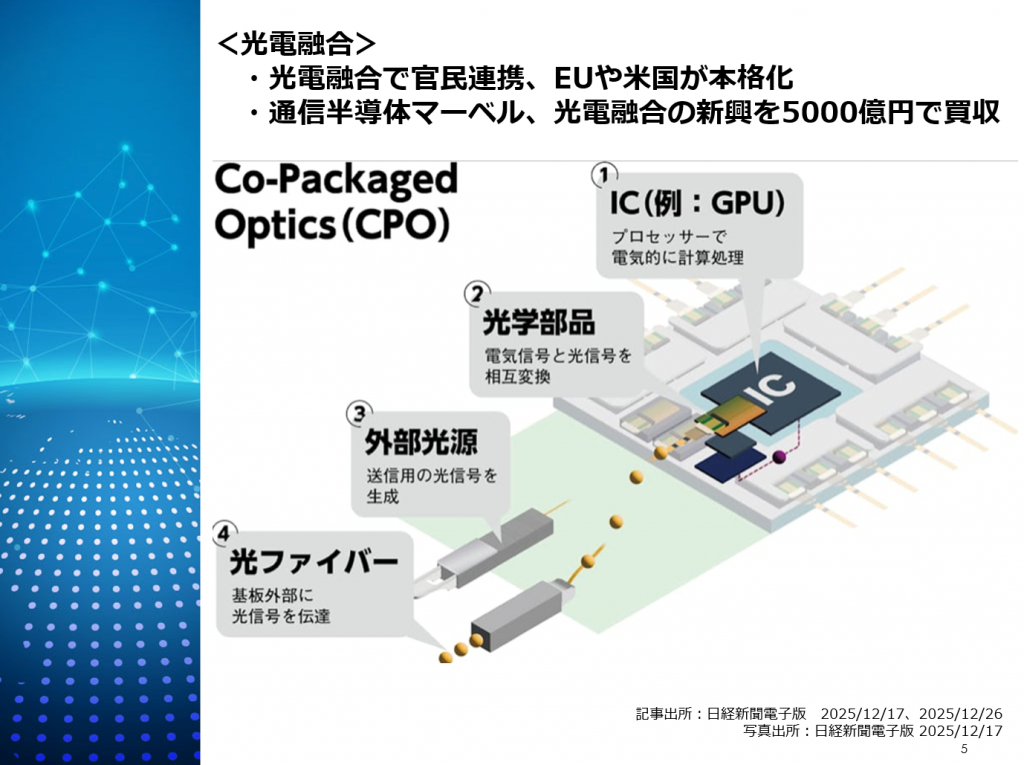

03:52 光電融合(CPO)と国家レベルの技術開発

データセンターの将来を左右する「光電融合」技術をめぐり官民連携と買収競争が本格化している、という内容です。

まず欧州では、CPO、いわゆるコ・パッケージド・オプティクスの開発に公的資金を投じ、データセンター向けに消費電力を下げつつ帯域を倍増させる技術開発を進めています。目標は総帯域204.8Tbpsで、ブロードコムの現行製品の2倍。GPUやAI ASIC(エイアイエーシック)への実装を想定しています。

一方米国では、国防総省が設立したAIM Photonics(エイムフォトンズ)が光IC製造や先端パッケージングを支援し、防衛用途も視野に技術基盤を強化しています。ポイントは「光の接続」。電気配線の限界を光で突破しようという動きです。

そして民間では、通信半導体大手マーベルが光I/O技術を持つセレスティアルAIを約5000億円で買収します。チップレット間やGPUとHBMの接続を光に置き換え、最大100Tbps、2.5pJ/bit(パルクールジュール/ビット)という高効率を実現。最大50m伝送も可能で、大規模AIデータセンターの内部接続を抜本的に変える可能性があります。

つまり今、データセンターのボトルネックである「帯域」と「消費電力」を解決する鍵として、光電融合が国家戦略レベルで動いています。GPU時代の次は“光インターコネクト”が主戦場になる可能性がある、というのが大きなポイントです。

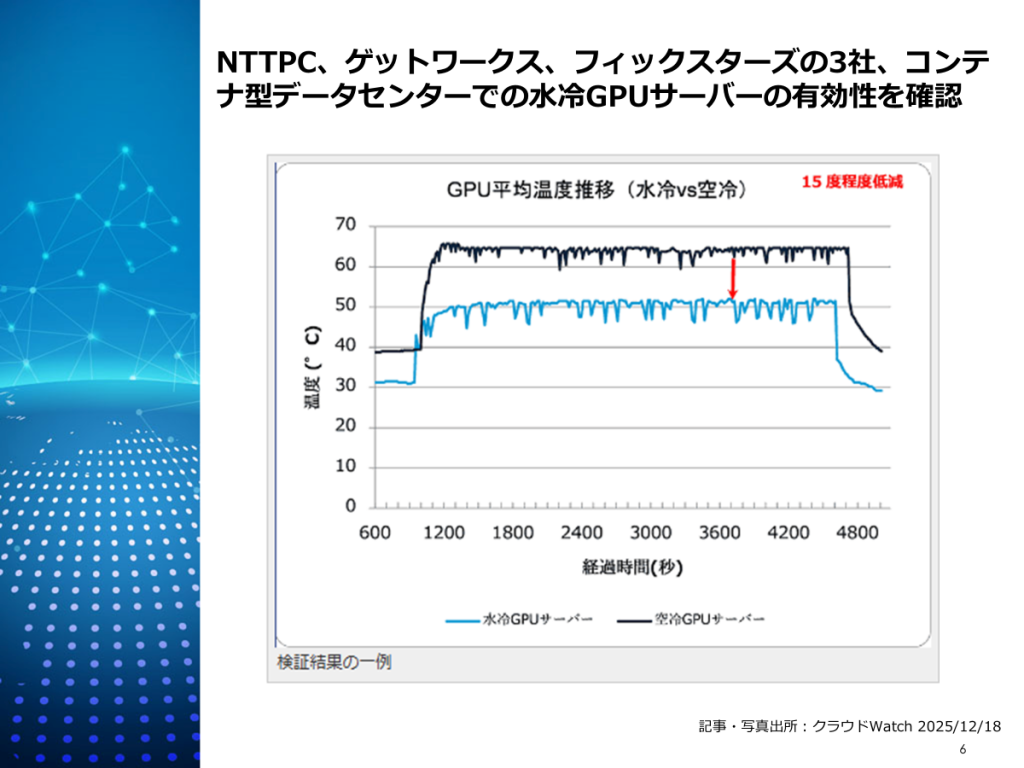

05:14 水冷GPUコンテナ型データセンターPoC

続いて技術実証に関する記事を3つお届けします。

1つ目は、NTTPC、ゲットワークス、フィックスターズの3社が、コンテナ型データセンターにおける水冷GPUサーバーの商用有効性をPoCで確認した、という内容です。

ポイントは、GPU専用のコンテナ型データセンターで水冷GPUサーバーを実際に稼働させて、データセンター設備・サーバー・ソフトウェアを統合的にチューニングしながら検証を行った点です。

その結果、電力使用効率を示すpPUE(パーシャルピーユーイー)は1.114という非常に優秀な数値を記録しました。さらに、最大負荷時でもGPUの平均温度を約15℃低減できたということで、冷却効率の高さが実証されています。

また、CDUなどの冷却モジュールやInRow空調を含め、コンテナ内の電力や温度を統合管理するモニタリングシステムも構築されており、商用環境としての完成度も確認されました。

今後、GPUの高性能化に伴い水冷需要はさらに拡大すると見られており、日本国内のコンテナ型データセンターにおける水冷GPUの本格展開が加速しそうです。

06:11 データセンターと再生可能エネルギー

続いてのニュースは、キヤノンITSが西東京データセンター2号棟に太陽光発電設備を導入して、実証実験を開始したという内容です。

ポイントは、データセンターの電力を一部“自家発電”で賄う取り組みを本格的に検証し始めた点です。年間の想定発電量は約69MWh(メガワットアワー)で、再生可能エネルギーを活用することで、環境負荷の低減と電力コスト抑制の両立を目指しています。

すでに2024年4月からは再エネ由来電力の外部調達も行っており、今回の太陽光導入は、その取り組みをさらに一段進めるものになります。

また注目すべきはBCPの観点です。災害時や緊急時の電力供給手段を多様化できるため、レジリエンス強化にもつながる施策と位置付けられています。

今後は蓄電池やオフサイトPPAの導入も視野に入れており、再エネを軸にした持続可能なデータセンター運営をさらに強化していく方針です。

07:11 ワット・ビット連携とワークロードシフト

続いては、東京大学と富士通が「ワット・ビット連携」の社会実装に向けて、データセンター間で計算処理を移動させる実証実験を行うというニュースです。

背景にあるのは、AI需要の拡大によるデータセンターの電力消費増加です。そこで、電力の状況に応じて計算処理の場所を動かす、いわゆる“ワークロードシフト”を行い、電力需給の最適化を図ろうという取り組みです。

具体的には、東大柏キャンパスの情報基盤センターと、富士通の国内データセンター上のクラウド環境を接続し、電力系統の負荷状況や市場価格と連動して、地域間で処理を移動できるかを検証します。国内で計算処理をシフトする実証は初の取り組みとのことです。

コンテナ技術を活用することで、ロケーションに依存せずに処理を移動可能にし、将来的には再生可能エネルギーの多い地域に負荷を寄せるなど、カーボンニュートラル型の分散データセンター構想につなげていきます。今後はAPNなど次世代通信も活用し、ソブリン性を確保した分散型データセンターの実現を目指す点が大きなポイントです。

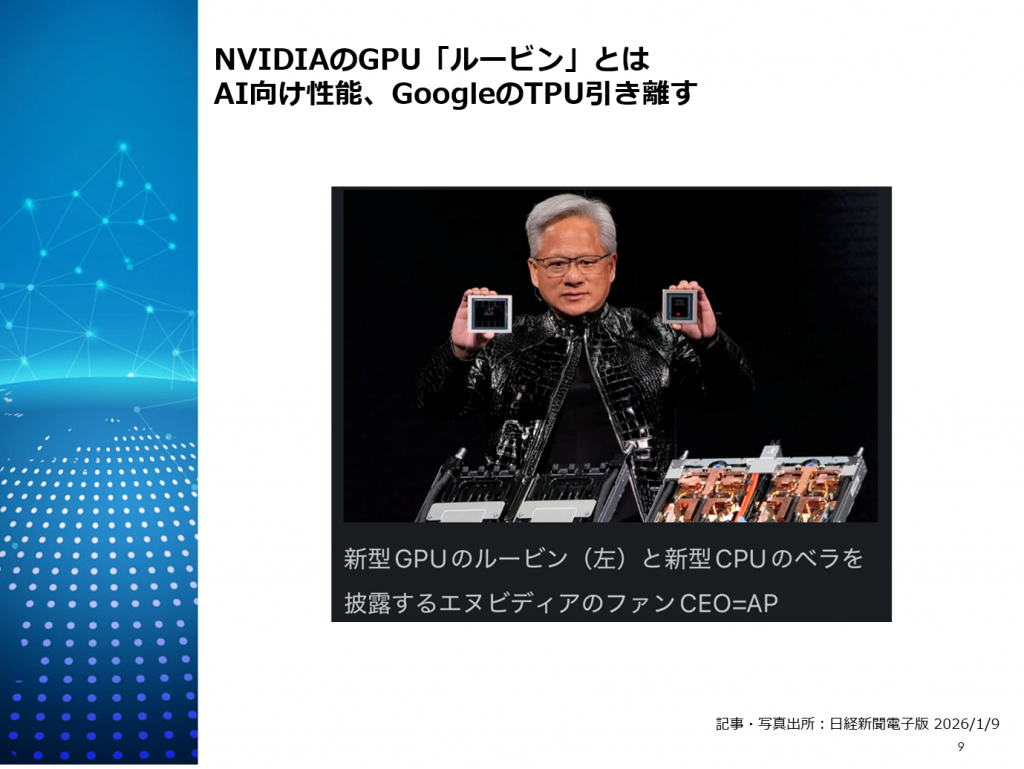

07:58 NVIDIA次世代GPU「Rubin」

NVIDIAが次世代AI向けGPU「ルービン」の量産を開始したという記事です。

このルービンは、現行のブラックウェルの後継にあたる製品で、AIの学習性能が約3.5倍、推論性能が約5倍に向上するとされています。つまり、データセンターでのAI処理能力が一段と引き上がることになります。

GPUはCPUと組み合わせて、データセンター向けサーバーの中核を担う存在です。AI需要が急増する中で、この性能向上はそのまま大規模AIクラスタやハイパースケールデータセンターの競争力に直結します。

現在、NVIDIAはAI半導体市場で約8割のシェアを持っており、GoogleのTPUなど競合もありますが、最先端性能では依然リードしています。さらに今後は毎年新型を投入する計画で、性能面での優位を維持する戦略です。

一方で、中国向け輸出規制が大きな論点となっており、データセンター市場の地域戦略も含めて、今後の動向が注目されます。

08:58 アジア最大級の海底ケーブル計画

続いての記事は、NTTデータグループと住友商事などが、総額1500億円規模でアジア最大級の国際海底ケーブルを新設するという内容です。

日本・韓国・マレーシア・シンガポールを結ぶ全長約8100kmの海底ケーブルで、伝送容量は毎秒約320テラビットと、アジア最大級になります。2029年度初頭の運用開始を目指しています。

データセンターの観点で見ると、生成AIや動画配信の拡大でアジア圏のデータ通信量が急増しており、国際バックボーンの強化は不可欠です。特に日本は国際通信の99%を海底ケーブルに依存しているため、容量増強と複線化は、データセンタービジネスの基盤そのものになります。

日本国内では千葉・三重・福岡の3カ所に陸揚げ局を分散設置し、災害時のリスク低減も図ります。これはデータセンターのBCP強化にも直結するポイントです。 今後、アジア各国のデータセンター需要やテック大手のトラフィックを取り込むインフラとして、経済安全保障とデータセンター競争力の両面で重要なプロジェクトと言えます。

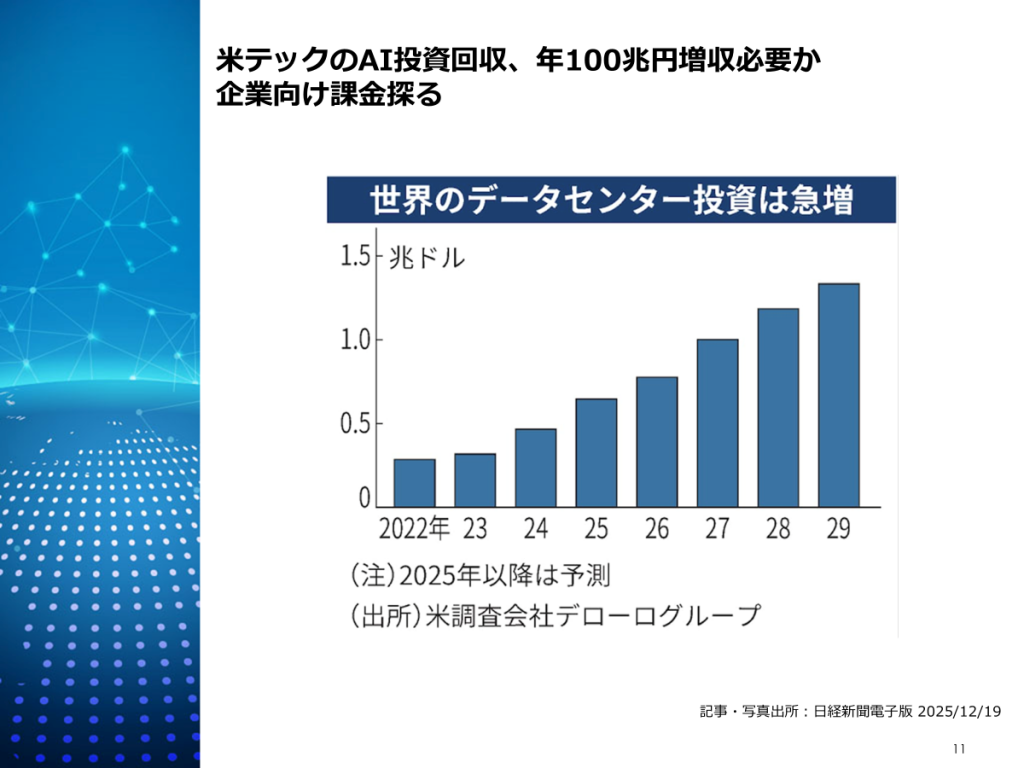

10:00 AIデータセンター投資の回収問題

続いては、米テック企業によるAI向けデータセンター投資の回収ハードルが非常に高くなっている、というニュースです。

JPモルガンの試算では、2028年にはテック企業のデータセンター投資額が約1兆ドル、日本円で約150兆円規模に達する見込みです。そして、この投資を年率10%で回収するには、年間で約100兆円の新たな売上が必要になるとされています。

データセンターの観点で重要なのは、この巨額投資の大半がAI半導体やサーバー設備に向けられている点です。クラウド大手ではAI向けデータセンター投資の約7割が半導体関連とされ、しかも半導体は1年ごとに世代交代しています。一方で減価償却は5~6年。投資回収モデルが崩れれば、設備の価値低下リスクもあります。

消費者向け課金だけでは回収が難しいため、AWSなどは企業向けAIエージェントを軸に、従量課金モデルで処理量を増やす戦略を打ち出しています。つまり、企業利用をどれだけ拡大できるかが、AIデータセンター投資の成否を左右する構図になっています。

11:01 軽量AIモデルと分散型インフラ

AI向けデータセンター投資が過熱する一方で、その前提が変わる可能性が出てきた、という内容です。

今、オープンAIの「スターゲート」構想をはじめ、米テック各社が数十兆円規模で大規模データセンターを建設しています。背景には、GPUを大量に投入すればAI性能が向上するという「スケーリング則」があります。実際、NVIDIAのGPU確保が競争力を左右する状況です。

ただ一方で、AIモデルの軽量化が進んでいます。例えば、Microsoftの「Phi-4」(ファイ・フォー)やNTTの「tsuzumi2」(ツヅミツー)は比較的少ないパラメーターでも高性能を実現し、GPU1個で動くモデルも登場しています。これにより、クラウドの巨大データセンターだけでなく、オンプレミスやエッジ側への分散も現実味を帯びてきました。

さらに、GPUに依存しない動きとして、独自ASIC(エーシック)や光コンピューティング、量子技術の研究も進んでいます。将来的には「大規模集中型データセンター」対「軽量・分散型+ポストGPU技術」という構図に変化する可能性があります。

データセンター市場は今後も拡大が続く一方で、そのアーキテクチャや勢力図は変わる可能性がある、というのが大きなポイントです。

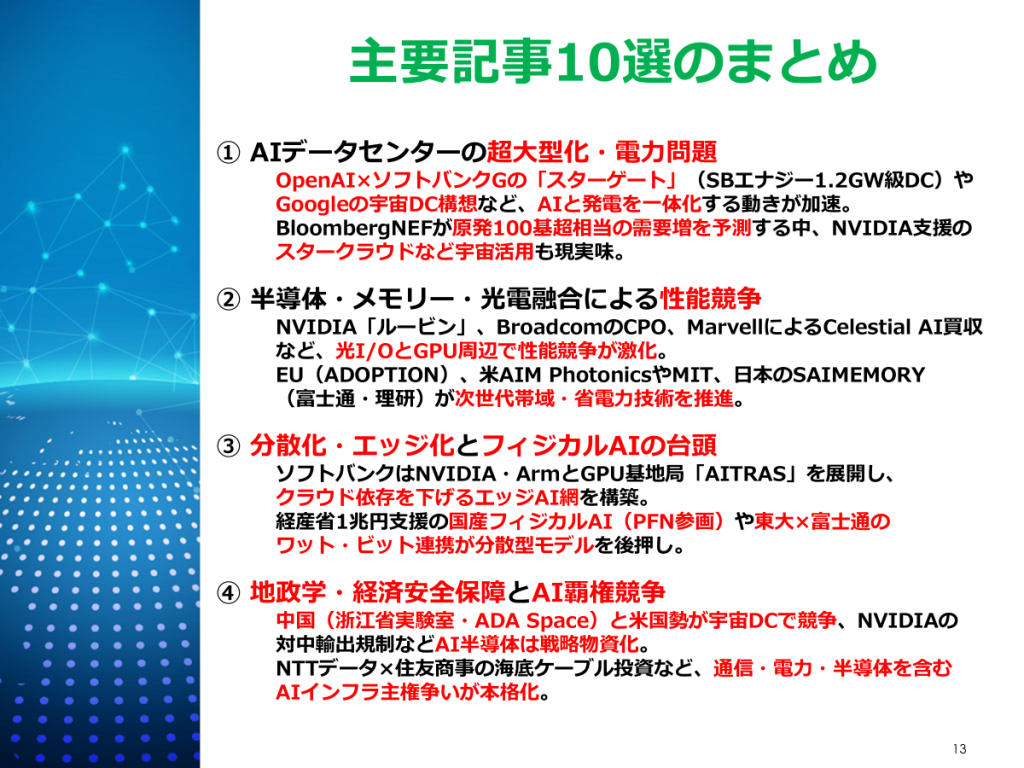

12:07 主要記事まとめ

今月の主要記事10選ですが、下記4つの観点にまとめられると思います。

まず一つ目の「AIデータセンターの超大型化・電力問題」ですが、AI需要の爆発的増加により、米国では原発100基超規模の電力が必要との予測も出ており、データセンターの超大型化が進行しており、OpenAIやGoogleはGW(ギガワット)級施設や宇宙データセンター構想まで打ち出し、電力確保が競争力の核心になりつつあります。

発電併設型データセンターや再エネ活用など、「電力を押さえる者がAIを制する」構図が鮮明化しています。

2つ目の「半導体・メモリー・光電融合による性能競争」では、NVIDIAの高性能GPUを軸に競争が続く一方、HBM代替メモリーや光電融合(CPO・光I/O)が次世代の主戦場になりつつあるなか、欧米は国家主導で光インターコネクト開発を加速、日本も次世代メモリーで巻き返しを狙っています。

AI データセンターのボトルネックは「帯域・消費電力・接続」であり、ポストGPU技術の争奪が激化しています。

つづいての「分散化・エッジ化とフィジカルAIの台頭」では、巨大集中型データセンターに加え、AI基地局や軽量モデルによる分散処理が拡大しています。ソフトバンクのGPU基地局や国産フィジカルAI構想は、ロボ・自動運転向け低遅延基盤を狙っており、「クラウド集中」から「エッジ分散」へ、AIインフラのアーキテクチャに変化が訪れています。

最後の「地政学・経済安全保障とAI覇権競争」ですが、AIインフラは米中対立の核心へ拡大してきており、宇宙データセンターや海底ケーブルも戦略領域に突入してきました。

半導体輸出規制、国産AI開発支援など、各国が自立型AI基盤の確保を急ぐなか、AI時代は技術競争だけでなく、「インフラ主権」を巡る国家戦略の段階に入ったといえるでしょう。

#データセンター

#セブンシックス

#AIインフラ

#時事ネタ

#テクノロジー